Teste DeepSeek V4 kostenlos im Felo LLM Playground

Der Felo LLM Playground fügt am Starttag DeepSeek V4-Pro und V4-Flash hinzu. Chatte kostenlos mit dem Open-Source-Modell mit Billionen Parametern – kein API-Schlüssel erforderlich.

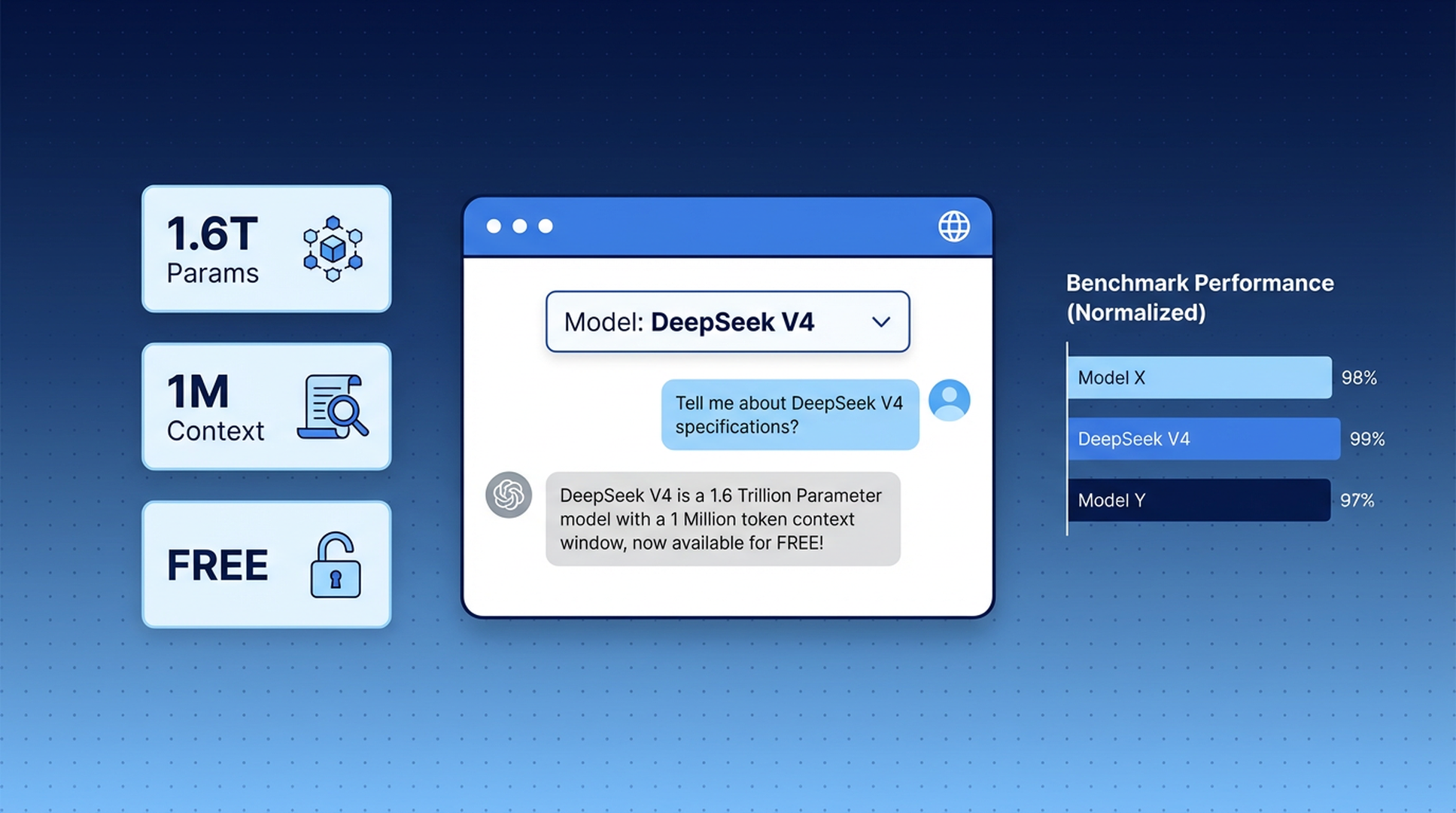

DeepSeek V4 wurde diese Woche veröffentlicht — ein Open-Source-Modell mit einer Billion Parametern, das in den meisten Benchmarks mit GPT-5.4 und Claude Opus 4.6 mithält. Es ist das bisher stärkste veröffentlichte Open-Weight-Modell.

Du kannst jetzt sofort kostenlos im Felo LLM Playground mit ihm chatten. Kein API-Schlüssel, keine Credits, kein Konto erforderlich. Wähle einfach das Modell aus und beginne zu sprechen.

Was ist der Felo LLM Playground?

Der Felo LLM Playground ist eine kostenlose, browserbasierte Chat-Oberfläche, in der du mit den weltweit führenden KI-Modellen Seite an Seite sprechen kannst. Denk daran wie an eine Testküche für LLMs — du bringst die Fragen, und du kannst wählen, welches Modell sie beantwortet.

Der Playground unterstützt derzeit Modelle von OpenAI, Anthropic, Google und jetzt auch DeepSeek. Du kannst mitten im Gespräch zwischen Modellen wechseln, Antworten vergleichen und herausfinden, welches am besten für deine spezifische Aufgabe funktioniert — alles ohne separate API-Konten oder Abrechnungsmanagement.

Er wurde für alle entwickelt, die die neuesten Modelle ohne Hürden ausprobieren möchten. Entwickler, die Modelle für ein Projekt evaluieren. Forscher, die die Qualität des logischen Denkens vergleichen. Studierende, die einen leistungsfähigen KI-Assistenten benötigen, aber nicht 20 $ pro Monat für jeden Anbieter zahlen wollen. Oder einfach alle, die neugierig sind, wie sich ein Modell mit einer Billion Parametern tatsächlich anfühlt.

DeepSeek V4: worauf Sie Zugriff erhalten

DeepSeek V4 ist in zwei Varianten erhältlich, und beide sind im Playground verfügbar:

DeepSeek V4-Pro ist das vollwertige Modell. 1,6 Billionen Gesamtparameter, 49 Milliarden aktive pro Anfrage, trainiert auf 32 Billionen Token. Es bewältigt komplexes Denken, Programmierung, Mathematik und die Analyse langer Dokumente auf einem Niveau, das direkt mit den besten geschlossenen Modellen konkurriert.

DeepSeek V4-Flash ist die schnelle Version. 284 Milliarden Gesamtparameter, 13 Milliarden aktiv. Es liefert Ihnen schnelle und leistungsfähige Antworten auf Alltagsfragen ohne die Latenz des größeren Modells.

Beide teilen sich ein Kontextfenster von einer Million Token – genug, um eine komplette Codebasis, ein buchlanges Dokument oder monatelange Sitzungsnotizen in einem einzigen Gespräch zu verarbeiten.

Wie es sich schlägt

So schneidet V4-Pro im Vergleich zu den aktuellen Schwergewichten ab:

| Benchmark | DeepSeek V4-Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|

| MMLU | 90,1% | ~91% | ~89% |

| HumanEval | 76,8% | ~78% | ~77% |

| SWE-bench Verified | 80,6% | ~82% | ~80% |

| Codeforces-Bewertung | 3.206 | ~3.100 | ~2.900 |

| MATH | 64,5% | ~66% | ~63% |

V4-Pro führt beim kompetitiven Programmieren und erreicht oder übertrifft GPT-5.4 bei mehreren Codierungsaufgaben. Der erweiterte Denkmodus (V4-Pro-Max) erzielte 93,5 % bei LiveCodeBench und 89,8 % bei IMOAnswerBench.

Die Lücke zwischen Open-Source- und Closed-Source-Modellen war noch nie so klein. Bei einigen Aufgaben ist sie vollständig verschwunden.

Wie man DeepSeek V4 im Playground verwendet

Es dauert etwa fünf Sekunden:

1. Öffne den Playground.

Gehe in deinem Browser zu playground.felo.ai. Keine Anmeldung erforderlich.

2. Wähle DeepSeek V4 im Modellwahlschalter aus.

Du siehst ein Dropdown-Menü mit allen verfügbaren Modellen. Wähle V4-Pro für komplexe Aufgaben oder V4-Flash für schnelle Antworten.

3. Beginne zu chatten.

Gib deine Frage ganz natürlich ein. Das Modell antwortet in Echtzeit – genau wie bei jeder anderen Chat-Oberfläche, die du zuvor verwendet hast.

Das ist die gesamte Einrichtung. Keine API-Schlüssel-Konfiguration, keine Token-Budgets, keine Abrechnungsseite.

Ein paar Dinge, die es sich lohnt auszuprobieren

Wenn du nicht weißt, wo du anfangen sollst, hier sind einige Eingabeaufforderungen, die zeigen, was V4 leisten kann:

- Füge eine lange Codedatei ein und bitte V4-Pro, Fehler zu finden oder Refaktorisierungen vorzuschlagen

- Gib ihm ein mathematisches Problem – Wettbewerbsniveau, wenn du es herausfordern möchtest

- Bitte es, ein technisches Konzept auf eine bestimmte Weise zu erklären („erkläre Transformatoren, als wäre ich ein Datenbankingenieur“)

- Füge eine Zusammenfassung eines Forschungspapiers ein und bitte um eine kritische Analyse

- Probiere dieselbe Eingabeaufforderung in V4-Pro und GPT-5.4 nebeneinander aus – der Playground macht das einfach

Wann man V4-Pro vs. V4-Flash wählen sollte

Beide Modelle sind im Playground verfügbar, und die Wahl zwischen ihnen ist einfach.

V4-Pro ist das Modell, das man verwenden sollte, wenn die Aufgabe schwierig ist. Forschungssynthesen, Fehlersuche in komplexem Code, mathematische Beweise, Analyse langer Dokumente – alles, was von tiefgehendem Denken profitiert. Es ist langsamer, aber es denkt gründlicher.

V4-Flash ist für alles andere gedacht. Schnelle Faktenabfragen, Textentwürfe, Brainstorming, Übersetzungen, Zusammenfassungen. Es antwortet schneller und bewältigt Routineaufgaben genauso gut wie das größere Modell. Wenn Sie in einer Sitzung viele Fragen stellen, hält V4-Flash den Ablauf flüssig.

Eine gute Faustregel: Beginnen Sie mit V4-Flash. Wenn die Antwort oberflächlich wirkt oder die Aufgabe offensichtlich komplex ist, wechseln Sie zu V4-Pro. Der Playground ermöglicht es, das Modell während des Gesprächs zu wechseln – es gibt also keine Nachteile beim Experimentieren.

Warum der Playground wichtig ist, um neue Modelle auszuprobieren

Jedes Mal, wenn ein neues Modell veröffentlicht wird, stellt sich dieselbe Frage: Wie kann man es eigentlich ausprobieren?

Die offizielle API erfordert eine Registrierung, das Hinzufügen einer Kreditkarte, das Schreiben von Code für Anfragen und die Verwaltung von Token-Kosten. Das ist sinnvoll, wenn man das Modell in ein Produkt integrieren möchte. Es ist jedoch übertrieben, wenn man ihm nur ein paar Fragen stellen und sehen will, wie es denkt.

Der Felo LLM Playground beseitigt diesen gesamten Prozess. Ein neues Modell erscheint, Sie öffnen einen Browser-Tab – und schon verwenden Sie es. Keine Einrichtung, keine Kosten, keine Verpflichtung.

Das ist wichtiger, als es zunächst klingt. Der Unterschied zwischen „Ich sollte dieses neue Modell ausprobieren“ und dem tatsächlichen Ausprobieren besteht meist aus 20 Minuten Kontoeinrichtung und API-Konfiguration. Die Playground-Umgebung reduziert das auf null.

Sie macht auch den Modellvergleich praktisch. Möchten Sie wissen, ob DeepSeek V4 Ihren Anwendungsfall besser bewältigt als Claude oder GPT? Stellen Sie dieselbe Frage an jedes Modell in benachbarten Tabs. In fünf Minuten praktischer Tests lernen Sie mehr als durch das Lesen von Benchmark-Tabellen.

Warum sich DeepSeek V4 lohnt, auszuprobieren

Über die Benchmark-Zahlen hinaus bietet V4 einige Dinge, die wirklich interessant sind, persönlich zu erleben:

Drei Denkmodi. V4 bietet Non-Think (schnelle, direkte Antworten), Think High (Schritt-für-Schritt-Analyse) und Think Max (maximale Denkanstrengung). Sie spüren den Unterschied – Think Max liefert bei einem schwierigen Mathematikproblem deutlich gründlichere Arbeit als der Standardmodus. Im Playground bedeutet das, dass Sie einstellen können, wie viel Rechenleistung das Modell auf Ihre Frage verwendet. Eine schnelle Faktenprüfung braucht kein Think Max. Ein kniffliger Beweis schon.

Starke mehrsprachige Leistung. V4 wurde mit starkem Schwerpunkt auf mehrsprachige Daten trainiert. Wenn Sie sprachübergreifend arbeiten – Englisch und Chinesisch, Japanisch und Koreanisch oder beliebige Kombinationen – bewältigt V4 Code-Switching und sprachübergreifende Fragen problemlos. Stellen Sie eine Frage auf Englisch zu einer chinesischsprachigen Quelle, und es kommt nicht aus dem Takt.

Programmierfähigkeit. Mit einer Codeforces-Bewertung von 3.206 und 80,6 % auf SWE-bench ist V4-Pro eines der leistungsstärksten Codiermodelle, die Sie heute verwenden können. Bitten Sie es, eine Funktion zu schreiben, einen Pull Request zu überprüfen oder zu erklären, warum Ihr Regex nicht übereinstimmt – es liefert konstant gute Ergebnisse. Der Playground ist ein schneller Weg, das zu testen: Fügen Sie einen Codeschnipsel ein, bitten Sie um eine Überprüfung und vergleichen Sie V4s Feedback mit Claude oder GPT.

Der Millionen-Token-Kontext. Die meisten Modelle sind bei 128 K oder 200 K Tokens begrenzt. V4 verarbeitet eine Million. Das entspricht etwa 750.000 Wörtern – rund zehn vollständigen Romanen oder der gesamten internen Dokumentation eines mittelgroßen Unternehmens. Sie können den gesamten Codebestand eines Projekts einfügen und Fragen dazu stellen, ohne ihn vorher aufzuteilen oder zusammenzufassen. Frühere Modelle zwangen Sie, diese Arbeit zu zerlegen. V4 nimmt sie als Ganzes.

Praktische Anwendungsfälle auf dem Playground

Hier sind einige Möglichkeiten, wie Menschen DeepSeek V4 bereits auf dem Playground nutzen:

Entwickler fügen Code ein und bitten V4-Pro, ihn zu überprüfen, Optimierungen vorzuschlagen oder unbekannte Muster zu erklären. Der Million-Token-Kontext bedeutet, dass man ein ganzes Modul – nicht nur eine einzelne Funktion – einfügen kann und Feedback erhält, das das Gesamtbild berücksichtigt. Einige Entwickler verwenden V4-Flash für schnelle Syntaxfragen und V4-Pro für Diskussionen auf Architekturebene.

Studierende nutzen V4-Pro-Max für Aufgaben in Mathematik und Naturwissenschaften. Der Think-Max-Reasoning-Modus geht Beweise Schritt für Schritt durch, was ihn nicht nur nützlich zum Finden von Antworten macht, sondern auch zum Verstehen des Lösungswegs. Außerdem ist er stark darin, Konzepte auf unterschiedlichen Niveaus zu erklären – wenn man ihn bittet, Gradientenabstieg für eine Erstsemesterstudentin oder einen Doktoranden zu erklären, erhält man merklich unterschiedliche Antworten.

Forschende geben V4 Paper-Abstracts oder ganze Abschnitte und bitten um kritische Analysen, methodische Lücken oder Verbindungen zu verwandten Arbeiten. Das mehrsprachige Training ist hier ebenfalls hilfreich – V4 kann mit Quellen auf Chinesisch, Japanisch oder Koreanisch arbeiten und sie auf Englisch besprechen, ohne Nuancen zu verlieren.

Autorinnen, Autoren und Marketingfachleute verwenden V4-Flash für Brainstorming, Entwürfe und Bearbeitung. Es ist schnell genug für iterative Arbeit – einen Entwurf schreiben, Feedback erhalten, überarbeiten, wiederholen – ohne die Verzögerung, die größere Modelle bei interaktiven Sitzungen frustrierend macht.

Vergleich von DeepSeek V4 mit anderen Modellen auf dem Playground

Der Playground bietet Zugriff auf Modelle verschiedener Anbieter. So fügt sich V4 ein:

Bei Programmieraufgaben gehört V4-Pro zu den besten verfügbaren Modellen. Es übertrifft Claude Opus 4.6 bei Codeforces und SWE-bench und liegt je nach spezifischer Aufgabe gleichauf oder vor GPT-5.4.

Beim Schreiben und Befolgen von Anweisungen hat Claude nach wie vor einen Vorsprung. Wenn Sie nuancierte Prosa oder eine sorgfältige Einhaltung komplexer Formatierungsanweisungen benötigen, sind Claude-Modelle in der Regel zuverlässiger.

In Bezug auf Allgemeinwissen und logisches Denken liegen V4-Pro, GPT-5.4 und Gemini 3.1 Pro nur um wenige Prozentpunkte auseinander. Der praktische Unterschied ist bei den meisten Fragen kaum bemerkbar.

In puncto Geschwindigkeit bei Routineaufgaben ist V4-Flash kaum zu übertreffen. Es reagiert schnell und ist leistungsfähig genug für die überwiegende Mehrheit alltäglicher Fragen.

Der eigentliche Vorteil des Playgrounds besteht darin, dass Sie niemandem beim Wort glauben müssen. Führen Sie Ihren eigenen Vergleich durch. Alle Modelle stehen direkt zur Verfügung.

Häufig gestellte Fragen

Ist DeepSeek V4 im Felo Playground wirklich kostenlos?

Ja. Sowohl V4-Pro als auch V4-Flash sind kostenlos verfügbar. Sie müssen kein Konto erstellen oder Zahlungsinformationen eingeben.

Muss ich etwas installieren?

Nein. Der Felo LLM Playground läuft vollständig im Browser unter playground.felo.ai. Funktioniert auf Desktop und Mobilgeräten.

Kann ich DeepSeek V4 in anderen Sprachen als Englisch verwenden?

Ja. V4 funktioniert gut in Englisch, Chinesisch, Japanisch, Koreanisch und vielen weiteren Sprachen. Es wurde mit einem starken mehrsprachigen Schwerpunkt trainiert.

Was ist der Unterschied zwischen Felo Playground und Felo Search?

Felo Search kombiniert KI-Modelle mit der Echtzeitsuche im Internet, um Ihnen Antworten zu geben, die auf aktuellen Informationen basieren – mit Quellenangaben. Der Playground ist eine direkte Chat-Oberfläche – keine Websuche, nur Sie und das Modell. Verwenden Sie Search, wenn Sie aktuelle Fakten benötigen; verwenden Sie den Playground, wenn Sie nachdenken, programmieren, schreiben oder Ideen erkunden möchten.

Gibt es ein Nutzungslimit?

Der Playground kann kostenlos genutzt werden. Während Zeiten mit hohem Datenverkehr können bestimmte Ratenbegrenzungen gelten, aber es gibt keine Token-Budgets oder täglichen Beschränkungen für die normale Nutzung.

Probieren Sie DeepSeek V4 jetzt aus

DeepSeek V4 ist im Felo LLM Playground verfügbar. Öffnen Sie einen Tab, wählen Sie das Modell aus und sehen Sie, was ein Open-Source-Modell mit einer Billion Parametern für Ihre Arbeit leisten kann.