Essayez DeepSeek V4 gratuitement sur Felo LLM Playground

Felo LLM Playground ajoute DeepSeek V4-Pro et V4-Flash le jour du lancement. Discutez gratuitement avec le modèle open source à un billion de paramètres — aucune clé API requise.

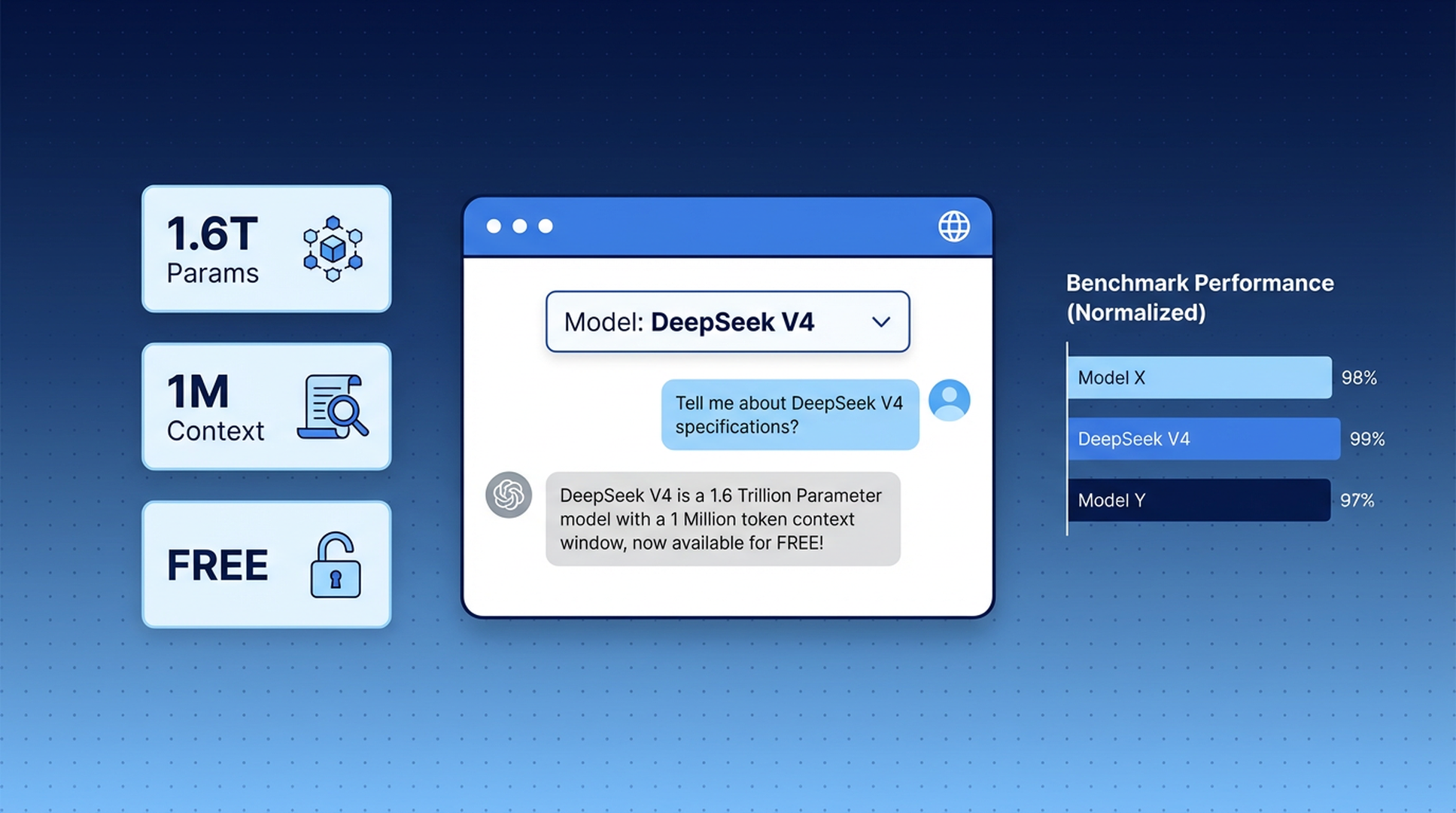

DeepSeek V4 a été lancé cette semaine — un modèle open-source à un billion de paramètres qui rivalise avec GPT-5.4 et Claude Opus 4.6 sur la plupart des benchmarks. C’est le modèle à poids ouverts le plus puissant publié à ce jour.

Vous pouvez discuter avec lui dès maintenant sur le Felo LLM Playground, gratuitement. Pas de clé API, pas de crédits, pas de compte requis. Choisissez simplement le modèle et commencez à parler.

Qu’est-ce que Felo LLM Playground ?

Felo LLM Playground est une interface de chat gratuite basée sur navigateur où vous pouvez dialoguer côte à côte avec les modèles d’IA les plus avancés au monde. Considérez-le comme une cuisine d’expérimentation pour les LLM — vous apportez les questions, et vous choisissez quel modèle y répond.

Le Playground prend actuellement en charge les modèles d’OpenAI, Anthropic, Google, et désormais DeepSeek. Vous pouvez passer d’un modèle à l’autre en pleine conversation, comparer les réponses et déterminer lequel fonctionne le mieux pour votre tâche spécifique — le tout sans créer de comptes API séparés ni gérer la facturation.

Il est conçu pour toute personne souhaitant essayer les derniers modèles sans friction. Les développeurs évaluant des modèles pour un projet. Les chercheurs comparant la qualité du raisonnement. Les étudiants ayant besoin d’un assistant IA performant mais ne voulant pas payer 20 $/mois pour chaque fournisseur. Ou toute personne simplement curieuse de savoir à quoi ressemble réellement l’utilisation d’un modèle à un billion de paramètres.

DeepSeek V4 : ce à quoi vous avez accès

DeepSeek V4 est proposé en deux variantes, toutes deux disponibles sur le Playground :

DeepSeek V4-Pro est le modèle complet. 1,6 billion de paramètres au total, 49 milliards actifs par requête, entraîné sur 32 billions de jetons. Il gère le raisonnement complexe, le codage, les mathématiques et l’analyse de longs documents à un niveau qui rivalise directement avec les meilleurs modèles propriétaires.

DeepSeek V4-Flash est la version rapide. 284 milliards de paramètres au total, 13 milliards actifs. Elle fournit des réponses rapides et performantes aux questions courantes sans la latence du modèle plus grand.

Les deux partagent une fenêtre de contexte d’un million de jetons — suffisante pour traiter l’ensemble d’une base de code, un document de la taille d’un livre ou plusieurs mois de comptes rendus de réunions dans une seule conversation.

Comment il se positionne

Voici où se situe le V4‑Pro face aux poids lourds actuels :

| Test de référence | DeepSeek V4-Pro | GPT‑5.4 | Claude Opus 4.6 |

|---|---|---|---|

| MMLU | 90,1 % | ~91 % | ~89 % |

| HumanEval | 76,8 % | ~78 % | ~77 % |

| SWE-bench Vérifié | 80,6 % | ~82 % | ~80 % |

| Note Codeforces | 3 206 | ~3 100 | ~2 900 |

| MATH | 64,5 % | ~66 % | ~63 % |

V4‑Pro est en tête pour la programmation compétitive et égale ou dépasse GPT‑5.4 sur plusieurs tâches de codage. Le mode de raisonnement étendu (V4‑Pro‑Max) a obtenu 93,5 % sur LiveCodeBench et 89,8 % sur IMOAnswerBench.

L'écart entre les modèles open source et fermés n’a jamais été aussi faible. Pour certaines tâches, il a complètement disparu.

Comment utiliser DeepSeek V4 sur le Playground

Cela prend environ cinq secondes :

1. Ouvrez le Playground.

Allez sur playground.felo.ai dans votre navigateur. Aucune connexion n’est nécessaire.

2. Sélectionnez DeepSeek V4 dans le sélecteur de modèles.

Vous verrez un menu déroulant avec tous les modèles disponibles. Choisissez V4-Pro pour les tâches complexes ou V4-Flash pour des réponses rapides.

3. Commencez à discuter.

Saisissez votre question naturellement. Le modèle répond en temps réel, comme dans n’importe quelle interface de chat que vous avez déjà utilisée.

C’est toute la configuration. Aucun paramétrage de clé API, aucun budget de jetons, aucune page de facturation.

Quelques choses à essayer

Si vous ne savez pas par où commencer, voici quelques invites qui montrent ce que V4 peut faire :

- Collez un long fichier de code et demandez à V4-Pro de trouver des bogues ou de suggérer des refactorisations

- Donnez-lui un problème de mathématiques — de niveau compétition si vous voulez le pousser

- Demandez-lui d’expliquer un concept technique d’une manière spécifique (« explique les transformeurs comme si j’étais un ingénieur en bases de données »)

- Déposez le résumé d’un article de recherche et demandez une analyse critique

- Essayez la même invite sur V4-Pro et GPT-5.4 côte à côte — le Playground rend cela facile

Quand choisir V4-Pro plutôt que V4-Flash

Les deux modèles sont disponibles sur le Playground, et le choix entre eux est simple.

V4-Pro est celui à utiliser lorsque la question est difficile. Synthèse de recherche, débogage de code complexe, démonstrations mathématiques, analyse de longs documents — tout ce qui bénéficie d’un raisonnement approfondi. Il est plus lent, mais il réfléchit plus profondément.

V4-Flash convient à tout le reste. Recherches factuelles rapides, rédaction de texte, brainstorming, traductions, résumés. Il répond plus vite et gère les tâches courantes tout aussi bien que le modèle plus grand. Si vous traitez beaucoup de questions au cours d’une session, V4-Flash permet de garder le rythme.

Une bonne règle générale : commencez avec V4-Flash. Si la réponse semble superficielle ou si la tâche est clairement complexe, passez à V4-Pro. Le Playground vous permet de changer de modèle en cours de conversation, donc il n’y a aucune pénalité à expérimenter.

Pourquoi le Playground est important pour tester de nouveaux modèles

Chaque fois qu’un nouveau modèle sort, le même problème se pose : comment l’essayer concrètement ?

L’API officielle nécessite une inscription, l’ajout d’une carte de crédit, l’écriture de code pour faire des requêtes, et la gestion des coûts de jetons. C’est parfait si vous intégrez le modèle dans un produit. C’est excessif si vous voulez simplement lui poser quelques questions et voir comment il raisonne.

Le Felo LLM Playground supprime tout ce processus. Un nouveau modèle est lancé ; vous ouvrez un onglet de navigateur et vous l’utilisez. Aucune configuration, aucun coût, aucun engagement.

Cela a plus d’importance qu’il n’y paraît. La différence entre « Je devrais essayer ce nouveau modèle » et le fait de réellement l’essayer correspond généralement à vingt minutes de configuration de compte et d’installation d’API. Le Playground ramène cela à zéro.

Il rend également la comparaison de modèles plus pratique. Vous voulez savoir si DeepSeek V4 gère mieux votre cas d’usage que Claude ou GPT ? Posez la même question à chaque modèle dans des onglets adjacents. Vous en apprendrez davantage en cinq minutes de test pratique qu’en consultant des tableaux de performances.

Ce qui rend DeepSeek V4 digne d’être essayé

Au-delà des chiffres de référence, V4 présente plusieurs aspects réellement intéressants à expérimenter par soi-même :

Trois modes de raisonnement. V4 propose « Non-Think » (réponses rapides et directes), « Think High » (analyse étape par étape) et « Think Max » (effort de raisonnement maximal). Vous pouvez sentir la différence : en mode Think Max, un problème de mathématiques difficile donne un travail sensiblement plus approfondi que le mode par défaut. Sur le Playground, cela signifie que vous pouvez ajuster la puissance de calcul que le modèle consacre à votre question. Une vérification factuelle rapide n’a pas besoin du mode Think Max. Une démonstration complexe, si.

Solides performances multilingues. V4 a été entraîné avec une forte emphase sur les données multilingues. Si vous travaillez entre plusieurs langues — anglais et chinois, japonais et coréen, ou toute autre combinaison — V4 gère bien le changement de code et les questions interlinguistiques. Posez une question en anglais sur une source en chinois, et il ne sera pas déstabilisé.

Capacité de programmation. Avec une note Codeforces de 3 206 et un score de 80,6 % sur SWE-bench, V4-Pro est l’un des modèles de programmation les plus performants que vous puissiez utiliser aujourd’hui. Demandez-lui d’écrire une fonction, de revoir une *pull request* ou d’expliquer pourquoi votre expression régulière ne correspond pas — il reste constamment bon. Le Playground est un moyen rapide de tester cela : collez un extrait, demandez une révision et comparez les commentaires de V4 avec ceux de Claude ou GPT.

Le contexte d’un million de jetons. La plupart des modèles s’arrêtent à 128K ou 200K jetons. V4 en gère un million. Cela représente environ 750 000 mots — soit une dizaine de romans complets ou la documentation interne entière d’une entreprise moyenne. Vous pouvez coller l’ensemble du code d’un projet et poser des questions à son sujet sans avoir à le fragmenter ni à le résumer au préalable. Les modèles précédents forçaient à diviser ce travail. V4 le traite dans son intégralité.

Cas d’utilisation pratiques sur le Playground

Voici quelques façons dont les utilisateurs exploitent déjà DeepSeek V4 sur le Playground :

Les développeurs collent leur code et demandent à V4-Pro de le revoir, de suggérer des optimisations ou d’expliquer des schémas inconnus. Le contexte d’un million de jetons signifie que vous pouvez y insérer un module entier — pas seulement une fonction — et recevoir des retours prenant en compte l’ensemble du contexte. Certains développeurs utilisent V4-Flash pour des questions rapides de syntaxe et V4-Pro pour des discussions d’architecture.

Les étudiants utilisent V4-Pro-Max pour des exercices de mathématiques et de sciences. Le mode de raisonnement Think Max parcourt les démonstrations étape par étape, ce qui le rend utile non seulement pour obtenir des réponses mais aussi pour comprendre la démarche. Il est également performant pour expliquer des concepts à différents niveaux — demandez-lui d’expliquer la descente de gradient à un étudiant de première année ou à un doctorant, et vous obtiendrez des réponses sensiblement différentes.

Les chercheurs soumettent à V4 des résumés ou des sections entières d’articles et lui demandent une analyse critique, l’identification de lacunes méthodologiques ou des liens avec des travaux connexes. L’entraînement multilingue est aussi un atout ici — V4 peut travailler avec des sources en chinois, japonais ou coréen et en discuter en anglais sans perdre la nuance.

Les rédacteurs et les spécialistes du marketing utilisent V4-Flash pour le brainstorming, la rédaction et la révision. Il est suffisamment rapide pour un travail itératif — rédigez un brouillon, obtenez un retour, révisez, répétez — sans la latence qui rend les modèles plus volumineux frustrants pour les échanges allers-retours.

Comparer DeepSeek V4 à d’autres modèles sur le Playground

Le Playground vous donne accès à des modèles provenant de plusieurs fournisseurs. Voici comment V4 s’y intègre :

Pour les tâches de programmation, V4-Pro fait partie des meilleurs disponibles. Il surpasse Claude Opus 4.6 sur Codeforces et SWE-bench, et alterne avec GPT-5.4 selon la tâche spécifique.

En matière de rédaction et de suivi des instructions, Claude conserve un avantage. Si vous avez besoin d’une prose nuancée ou d’un respect minutieux de consignes de mise en forme complexes, les modèles Claude ont tendance à être plus fiables.

En ce qui concerne les connaissances générales et le raisonnement, V4-Pro, GPT-5.4 et Gemini 3.1 Pro se situent à quelques points de pourcentage les uns des autres. La différence pratique est difficile à remarquer sur la plupart des questions.

Pour la rapidité des tâches courantes, V4-Flash est difficile à battre. Il est réactif et suffisamment performant pour la grande majorité des questions quotidiennes.

Le véritable avantage du Playground est que vous n’avez pas besoin de croire qui que ce soit sur parole. Faites votre propre comparaison. Les modèles sont tous là.

Foire aux questions

DeepSeek V4 est-il vraiment gratuit sur Felo Playground ?

Oui. V4-Pro et V4-Flash sont tous deux disponibles gratuitement. Vous n’avez pas besoin de créer un compte ni de saisir d’informations de paiement.

Dois-je installer quelque chose ?

Non. Felo LLM Playground fonctionne entièrement dans le navigateur à l’adresse playground.felo.ai. Compatible avec les ordinateurs de bureau et les appareils mobiles.

Puis-je utiliser DeepSeek V4 dans des langues autres que l'anglais ?

Oui. V4 fonctionne bien en anglais, chinois, japonais, coréen et dans de nombreuses autres langues. Il a été entraîné avec une forte orientation multilingue.

Quelle est la différence entre Felo Playground et Felo Search ?

Felo Search combine des modèles d'IA avec une recherche web en temps réel pour vous fournir des réponses basées sur des informations actuelles, avec des citations. Le Playground est une interface de chat directe — pas de recherche web, juste vous et le modèle. Utilisez Search lorsque vous avez besoin de faits à jour ; utilisez le Playground lorsque vous voulez raisonner, coder, écrire ou explorer des idées.

Y a‑t‑il une limite d’utilisation ?

Le Playground est gratuit. Des limites de débit spécifiques peuvent s’appliquer pendant les périodes de forte affluence, mais il n’y a pas de budgets de jetons ni de plafonds quotidiens pour une utilisation normale.

Essayez DeepSeek V4 dès maintenant

DeepSeek V4 est disponible sur Felo LLM Playground. Ouvrez un onglet, choisissez le modèle et découvrez ce qu’un modèle open‑source de mille milliards de paramètres peut apporter à votre travail.