Coba DeepSeek V4 Gratis di Felo LLM Playground

Felo LLM Playground menambahkan DeepSeek V4-Pro dan V4-Flash pada hari peluncuran. Mengobrol dengan model open-source berparameter triliun secara gratis — tanpa perlu kunci API.

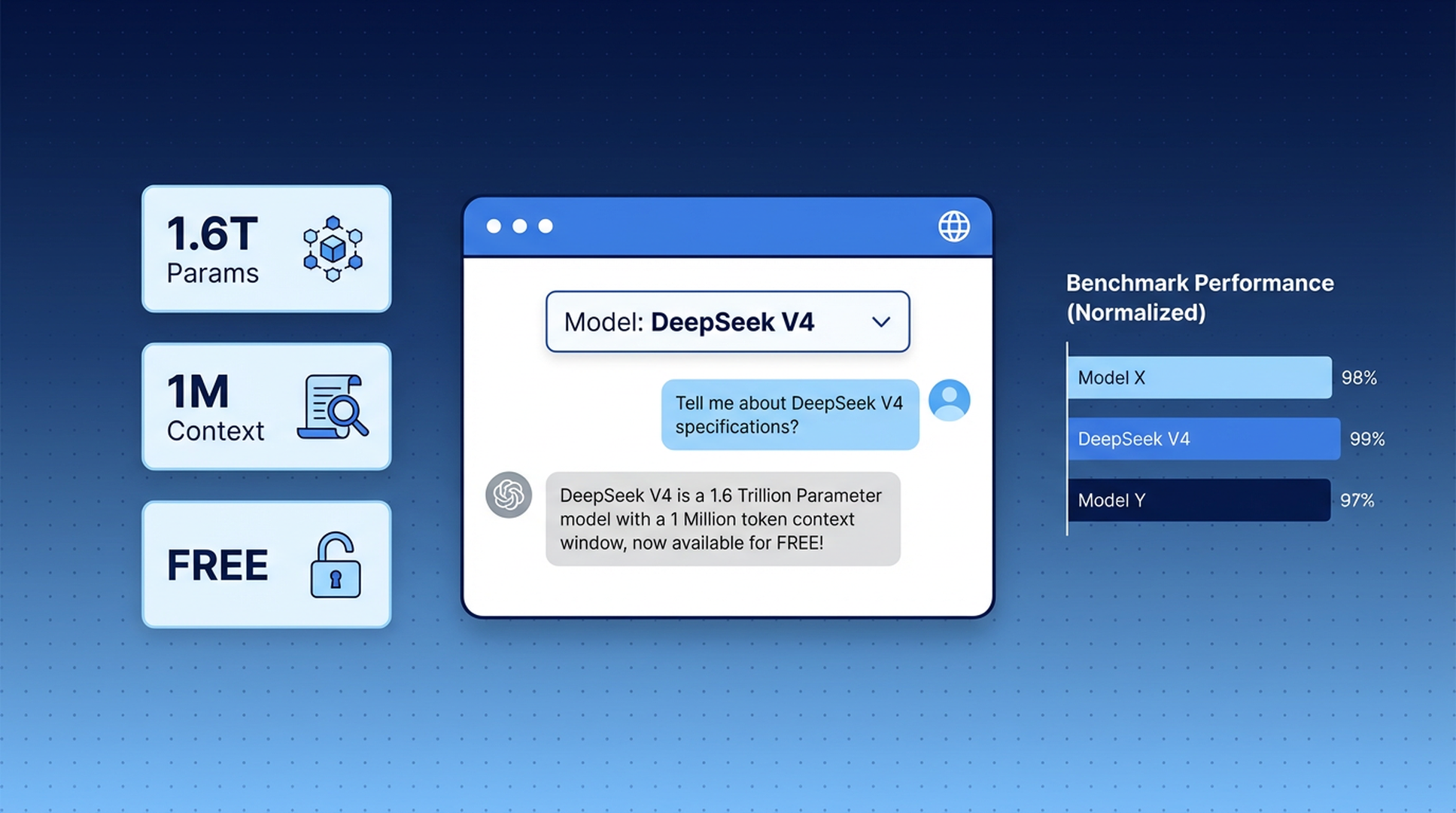

DeepSeek V4 diluncurkan minggu ini — model open-source dengan satu triliun parameter yang sebanding dengan GPT-5.4 dan Claude Opus 4.6 pada sebagian besar benchmark. Ini adalah model dengan bobot terbuka terkuat yang pernah dirilis hingga saat ini.

Kamu dapat mengobrol dengannya sekarang juga di Felo LLM Playground, secara gratis. Tanpa kunci API, tanpa kredit, tanpa akun yang diperlukan. Cukup pilih modelnya dan mulai berbicara.

Apa itu Felo LLM Playground?

Felo LLM Playground adalah antarmuka obrolan berbasis peramban gratis di mana kamu dapat berbicara dengan model AI terkemuka di dunia secara berdampingan. Anggap saja ini sebagai dapur uji untuk LLM — kamu membawa pertanyaannya, dan kamu bisa memilih model mana yang menjawabnya.

Playground saat ini mendukung model dari OpenAI, Anthropic, Google, dan sekarang DeepSeek. Kamu dapat beralih antar model di tengah percakapan, membandingkan respons, dan mencari tahu mana yang paling cocok untuk tugas spesifikmu — semuanya tanpa perlu mendaftar akun API terpisah atau mengelola pembayaran.

Ini dibuat untuk siapa saja yang ingin mencoba model terbaru tanpa hambatan. Pengembang yang sedang mengevaluasi model untuk proyek. Peneliti yang membandingkan kualitas penalaran. Mahasiswa yang membutuhkan asisten AI andal tetapi tidak ingin membayar $20/bulan untuk setiap penyedia. Atau siapa pun yang penasaran seperti apa rasanya menggunakan model dengan satu triliun parameter.

DeepSeek V4: apa yang Anda dapatkan aksesnya

DeepSeek V4 hadir dalam dua varian, dan keduanya tersedia di Playground:

DeepSeek V4-Pro adalah model ukuran penuh. Total 1,6 triliun parameter, 49 miliar aktif per kueri, dilatih pada 32 triliun token. Model ini mampu menangani penalaran kompleks, pemrograman, matematika, dan analisis dokumen panjang pada tingkat yang bersaing langsung dengan model tertutup terbaik.

DeepSeek V4-Flash adalah versi cepatnya. Total 284 miliar parameter, 13 miliar aktif. Versi ini memberikan respons cepat dan andal untuk pertanyaan sehari-hari tanpa latensi dari model yang lebih besar.

Keduanya memiliki jendela konteks satu juta token — cukup untuk memproses seluruh basis kode, dokumen sepanjang buku, atau catatan rapat selama berbulan-bulan dalam satu percakapan.

Perbandingannya

Berikut posisi V4-Pro dibandingkan dengan model unggulan saat ini:

| Benchmark | DeepSeek V4-Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|

| MMLU | 90,1% | ~91% | ~89% |

| HumanEval | 76,8% | ~78% | ~77% |

| SWE-bench Verified | 80,6% | ~82% | ~80% |

| Codeforces Rating | 3.206 | ~3.100 | ~2.900 |

| MATH | 64,5% | ~66% | ~63% |

V4-Pro unggul dalam pemrograman kompetitif dan mampu menyamai atau mengalahkan GPT-5.4 dalam beberapa tugas pemrograman. Mode penalaran lanjutan (V4-Pro-Max) meraih skor 93,5% pada LiveCodeBench dan 89,8% pada IMOAnswerBench.

Kesenjangan antara model open-source dan model tertutup tidak pernah sekecil ini. Dalam beberapa tugas, perbedaannya bahkan sudah tidak ada sama sekali.

Cara menggunakan DeepSeek V4 di Playground

Hanya perlu sekitar lima detik:

1. Buka Playground.

Buka playground.felo.ai di peramban Anda. Tidak perlu login.

2. Pilih DeepSeek V4 dari pemilih model.

Anda akan melihat menu dropdown dengan semua model yang tersedia. Pilih V4-Pro untuk tugas yang kompleks atau V4-Flash untuk jawaban cepat.

3. Mulai mengobrol.

Ketik pertanyaan Anda secara alami. Model akan merespons secara real-time, seperti antarmuka chat yang pernah Anda gunakan sebelumnya.

Itu seluruh pengaturannya. Tidak perlu konfigurasi kunci API, tidak ada anggaran token, tidak ada halaman penagihan.

Beberapa hal yang layak dicoba

Jika Anda tidak yakin harus mulai dari mana, berikut beberapa prompt yang menunjukkan kemampuan V4:

- Tempelkan file kode yang panjang dan minta V4-Pro untuk menemukan bug atau menyarankan refaktor

- Berikan soal matematika — tingkat kompetisi jika Anda ingin menantangnya

- Minta untuk menjelaskan konsep teknis dengan cara tertentu ("jelaskan transformer seolah saya seorang insinyur basis data")

- Masukkan abstrak makalah penelitian dan minta analisis kritis

- Coba prompt yang sama pada V4-Pro dan GPT-5.4 secara berdampingan — Playground memudahkan hal ini

Kapan memilih V4-Pro vs. V4-Flash

Kedua model tersedia di Playground, dan memilih di antara keduanya cukup mudah.

V4-Pro adalah pilihan ketika pertanyaannya sulit. Sintesis riset, debugging kode yang rumit, pembuktian matematis, analisis dokumen panjang—apa pun yang memerlukan penalaran mendalam. Model ini lebih lambat, tetapi berpikir lebih mendalam.

V4-Flash digunakan untuk hal-hal lainnya. Pencarian fakta cepat, penulisan draf teks, brainstorming, penerjemahan, ringkasan. Model ini merespons lebih cepat dan menangani tugas rutin sebaik model yang lebih besar. Jika kamu menjalankan banyak pertanyaan dalam satu sesi, V4-Flash membuat semuanya tetap lancar.

Aturan praktis yang baik: mulai dengan V4-Flash. Jika jawaban terasa dangkal atau tugasnya jelas kompleks, beralihlah ke V4-Pro. Playground memungkinkanmu mengubah model di tengah percakapan, jadi tidak ada penalti untuk bereksperimen.

Mengapa Playground penting untuk mencoba model baru

Setiap kali model baru dirilis, masalah yang sama muncul: bagaimana cara mencobanya?

API resmi mengharuskan pendaftaran, menambahkan kartu kredit, menulis kode untuk membuat permintaan, dan mengelola biaya token. Itu tidak masalah jika kamu ingin mengintegrasikan model ke dalam produk, tetapi berlebihan jika kamu hanya ingin menanyakan beberapa pertanyaan dan melihat cara model berpikir.

Felo LLM Playground menghapus seluruh proses itu. Saat model baru diluncurkan, kamu cukup membuka tab browser dan langsung menggunakannya. Tanpa pengaturan, tanpa biaya, tanpa komitmen.

Hal ini lebih penting daripada yang terlihat. Perbedaan antara “Saya seharusnya mencoba model baru itu” dan benar-benar mencobanya biasanya memakan waktu 20 menit untuk menyiapkan akun dan konfigurasi API. Playground memangkas waktu itu menjadi nol.

Ini juga membuat perbandingan antar model menjadi praktis. Ingin tahu apakah DeepSeek V4 menangani kasus penggunaan Anda lebih baik daripada Claude atau GPT? Ajukan pertanyaan yang sama ke setiap model di tab yang bersebelahan. Anda akan belajar lebih banyak dalam lima menit pengujian langsung dibandingkan hanya membaca tabel tolok ukur.

Apa yang membuat DeepSeek V4 layak dicoba

Selain angka tolok ukur, V4 memiliki beberapa hal yang benar-benar menarik untuk dialami secara langsung:

Tiga mode penalaran. V4 menawarkan Non-Think (jawaban cepat dan langsung), Think High (analisis langkah demi langkah), dan Think Max (usaha penalaran maksimum). Anda dapat merasakan perbedaannya — Think Max pada soal matematika sulit menghasilkan pekerjaan yang jauh lebih menyeluruh dibandingkan mode default. Di Playground, ini berarti Anda dapat menyesuaikan seberapa besar daya komputasi yang digunakan model untuk menjawab pertanyaan Anda. Pemeriksaan fakta cepat tidak memerlukan Think Max. Bukti rumit, ya.

Kinerja multibahasa yang kuat. V4 dilatih dengan penekanan besar pada data multibahasa. Jika Anda bekerja lintas bahasa — Inggris dan Mandarin, Jepang dan Korea, atau kombinasi lainnya — V4 menangani pergantian kode dan pertanyaan lintas bahasa dengan baik. Ajukan pertanyaan dalam bahasa Inggris tentang sumber berbahasa Mandarin, dan model ini akan menjawab tanpa hambatan.

Kemampuan pemrograman. Dengan peringkat Codeforces 3.206 dan skor 80,6% di SWE-bench, V4-Pro adalah salah satu model pemrograman terkuat yang dapat Anda gunakan saat ini. Minta ia menulis sebuah fungsi, meninjau pull request, atau menjelaskan mengapa regex Anda tidak cocok — hasilnya selalu konsisten bagus. Playground adalah cara cepat untuk mengujinya: tempelkan potongan kode, minta tinjauan, dan bandingkan umpan balik dari V4 dengan Claude atau GPT.

Konteks sejuta token. Sebagian besar model dibatasi pada 128K atau 200K token. V4 menangani hingga satu juta. Itu kira-kira 750.000 kata — sekitar 10 novel penuh, atau seluruh dokumentasi internal perusahaan menengah. Anda dapat menempelkan seluruh basis kode proyek dan mengajukan pertanyaan tentangnya tanpa perlu memecah atau merangkum terlebih dahulu. Model sebelumnya mengharuskan Anda membagi pekerjaan itu menjadi beberapa bagian. V4 dapat memprosesnya sekaligus.

Kasus penggunaan praktis di Playground

Berikut adalah beberapa cara orang sudah menggunakan DeepSeek V4 di Playground:

Pengembang menempelkan kode dan meminta V4-Pro untuk meninjaunya, menyarankan optimisasi, atau menjelaskan pola yang tidak dikenal. Konteks sejuta token berarti Anda dapat memasukkan seluruh modul — tidak hanya satu fungsi — dan mendapatkan umpan balik yang mempertimbangkan gambaran secara keseluruhan. Beberapa pengembang menggunakan V4-Flash untuk pertanyaan sintaks cepat dan V4-Pro untuk diskusi di tingkat arsitektur.

Mahasiswa menggunakan V4-Pro-Max untuk soal-soal matematika dan sains. Mode penalaran Think Max memandu melalui pembuktian langkah demi langkah, yang membuatnya berguna tidak hanya untuk mendapatkan jawaban tetapi juga untuk memahami pendekatannya. Model ini juga kuat dalam menjelaskan konsep pada tingkat yang berbeda — mintalah menjelaskan penurunan gradien untuk mahasiswa tahun pertama dibandingkan dengan kandidat PhD, dan Anda akan mendapatkan tanggapan yang secara bermakna berbeda.

Peneliti memberikan V4 abstrak atau bagian penuh dari makalah dan meminta analisis kritis, celah metodologi, atau hubungan dengan karya terkait. Pelatihan multibahasa juga berguna di sini — V4 dapat bekerja dengan sumber dalam bahasa Mandarin, Jepang, atau Korea dan mendiskusikannya dalam bahasa Inggris tanpa kehilangan nuansa.

Penulis dan pemasar menggunakan V4-Flash untuk brainstorming, membuat draf, dan mengedit. Model ini cukup cepat untuk pekerjaan iteratif — tulis draf, dapatkan umpan balik, revisi, ulangi — tanpa latensi yang membuat model yang lebih besar membuat frustrasi untuk sesi bolak-balik.

Membandingkan DeepSeek V4 dengan model lain di Playground

Playground memberi Anda akses ke model dari berbagai penyedia. Berikut cara V4 menyesuaikan diri:

Dalam tugas pemrograman, V4-Pro termasuk yang terbaik yang tersedia. Model ini mengungguli Claude Opus 4.6 pada Codeforces dan SWE-bench, serta saling bergantian unggul dengan GPT-5.4 tergantung pada tugas spesifiknya.

Dalam hal penulisan dan mengikuti instruksi, Claude masih memiliki keunggulan. Jika Anda membutuhkan prosa yang bernuansa atau kepatuhan yang cermat terhadap instruksi format yang kompleks, model Claude cenderung lebih dapat diandalkan.

Dalam hal pengetahuan umum dan penalaran, V4-Pro, GPT-5.4, dan Gemini 3.1 Pro memiliki perbedaan hanya beberapa poin persentase satu sama lain. Perbedaan praktisnya sulit diperhatikan pada sebagian besar pertanyaan.

Dalam hal kecepatan untuk tugas-tugas rutin, V4-Flash sulit dikalahkan. Model ini responsif dan cukup mumpuni untuk sebagian besar pertanyaan sehari-hari.

Keunggulan nyata dari Playground adalah Anda tidak perlu mempercayai kata siapa pun. Jalankan perbandingan Anda sendiri. Semua model tersedia di sana.

Pertanyaan yang sering diajukan

Apakah DeepSeek V4 benar-benar gratis di Felo Playground?

Ya. Baik V4-Pro maupun V4-Flash tersedia tanpa biaya. Anda tidak perlu membuat akun atau memasukkan informasi pembayaran.

Apakah saya perlu menginstal sesuatu?

Tidak. Felo LLM Playground berjalan sepenuhnya di peramban pada playground.felo.ai. Berfungsi di desktop dan perangkat seluler.

Bisakah saya menggunakan DeepSeek V4 dalam bahasa selain bahasa Inggris?

Bisa. V4 bekerja dengan baik dalam bahasa Inggris, Tiongkok, Jepang, Korea, dan banyak bahasa lainnya. Model ini dilatih dengan fokus kuat pada kemampuan multibahasa.

Apa perbedaan antara Felo Playground dan Felo Search?

Felo Search menggabungkan model AI dengan pencarian web waktu nyata untuk memberikan jawaban yang didasarkan pada informasi terkini, lengkap dengan sumber kutipan. Playground adalah antarmuka obrolan langsung — tanpa pencarian web, hanya Anda dan model. Gunakan Search ketika Anda membutuhkan fakta terbaru; gunakan Playground ketika Anda ingin bernalar, membuat kode, menulis, atau menjelajahi ide.

Apakah ada batasan penggunaan?

Playground dapat digunakan secara gratis. Batas kecepatan tertentu mungkin berlaku selama periode lalu lintas tinggi, tetapi tidak ada batas token atau batas harian untuk penggunaan normal.

Coba DeepSeek V4 sekarang

DeepSeek V4 sudah tersedia di Felo LLM Playground. Buka tab, pilih model, dan lihat apa yang dapat dilakukan model sumber terbuka dengan triliun parameter ini untuk pekerjaan Anda.