Prova DeepSeek V4 gratuitamente su Felo LLM Playground

Felo LLM Playground aggiunge DeepSeek V4-Pro e V4-Flash il giorno del lancio. Chatta gratuitamente con il modello open-source da trilioni di parametri — non è necessaria alcuna chiave API.

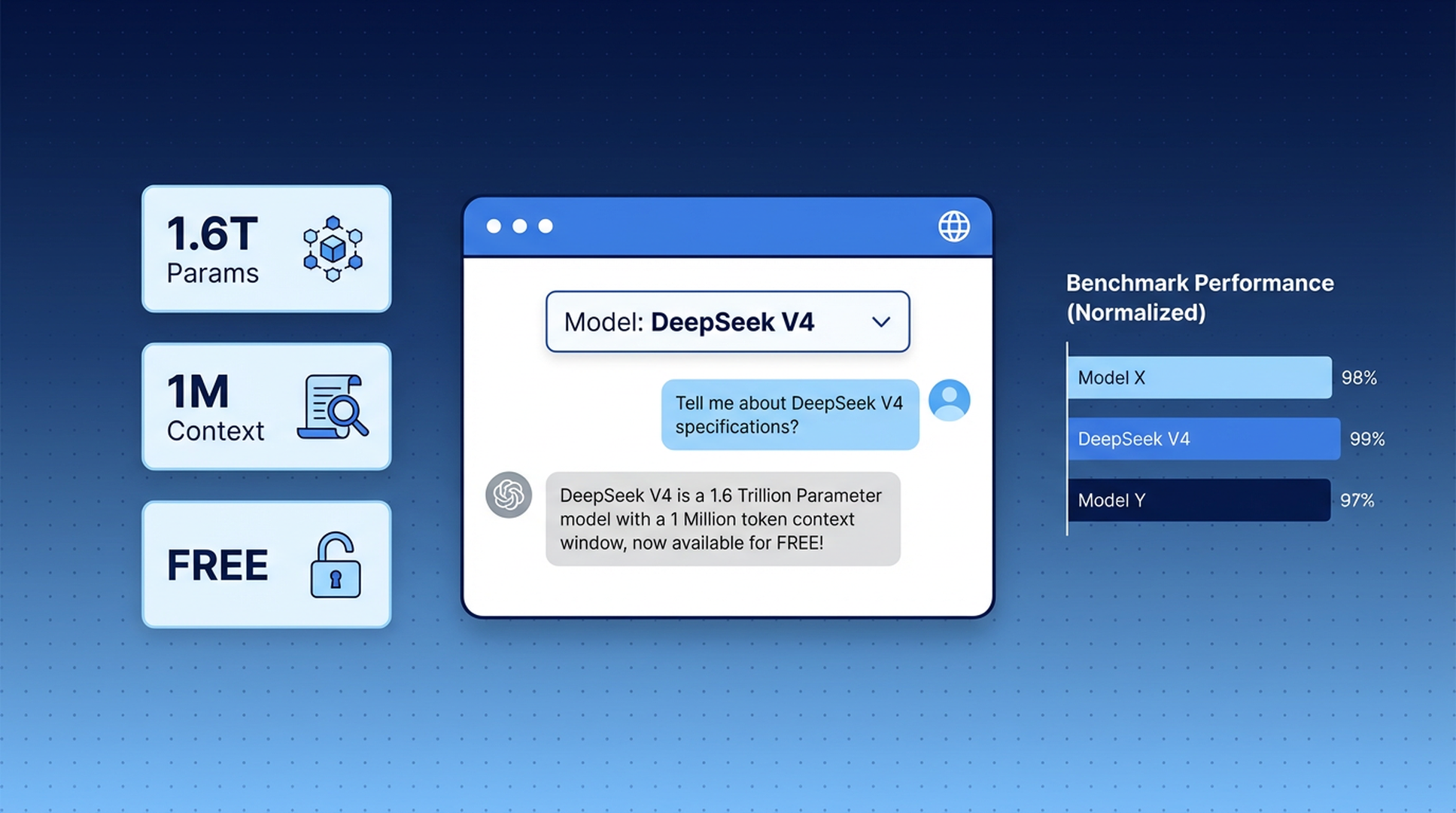

DeepSeek V4 è stato lanciato questa settimana — un modello open-source da un trilione di parametri che eguaglia GPT-5.4 e Claude Opus 4.6 nella maggior parte dei benchmark. È il modello a pesi aperti più potente rilasciato finora.

Puoi chattare con esso subito su Felo LLM Playground, gratuitamente. Nessuna chiave API, nessun credito, nessun account richiesto. Basta scegliere il modello e iniziare a parlare.

Che cos’è Felo LLM Playground?

Felo LLM Playground è un’interfaccia di chat gratuita basata su browser in cui puoi parlare fianco a fianco con i modelli di intelligenza artificiale più avanzati al mondo. Pensalo come una cucina di prova per LLM — tu porti le domande e puoi scegliere quale modello le risponde.

Il Playground attualmente supporta modelli di OpenAI, Anthropic, Google e ora DeepSeek. Puoi passare da un modello all’altro durante la conversazione, confrontare le risposte e capire quale funziona meglio per il tuo compito specifico — tutto senza creare account API separati o gestire la fatturazione.

È pensato per chiunque voglia provare i modelli più recenti senza ostacoli. Sviluppatori che valutano modelli per un progetto. Ricercatori che confrontano la qualità del ragionamento. Studenti che hanno bisogno di un assistente AI capace ma non vogliono pagare 20 $/mese per ogni provider. O chiunque sia semplicemente curioso di sapere come si comporta un modello da un trilione di parametri nell’uso reale.

DeepSeek V4: a cosa stai ottenendo accesso

DeepSeek V4 è disponibile in due varianti, entrambe accessibili nel Playground:

DeepSeek V4-Pro è il modello a grandezza completa. 1,6 trilioni di parametri totali, 49 miliardi attivi per query, addestrato su 32 trilioni di token. Gestisce ragionamento complesso, programmazione, matematica e analisi di documenti lunghi a un livello che compete direttamente con i migliori modelli chiusi.

DeepSeek V4-Flash è la versione veloce. 284 miliardi di parametri totali, 13 miliardi attivi. Ti offre risposte rapide e competenti per le domande di tutti i giorni, senza la latenza del modello più grande.

Entrambi condividono una finestra di contesto da un milione di token — sufficiente per elaborare un intero codice sorgente, un documento lungo come un libro o mesi di appunti di riunioni in un'unica conversazione.

Come si posiziona

Ecco dove si colloca V4-Pro rispetto ai principali concorrenti:

| Benchmark | DeepSeek V4-Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|

| MMLU | 90,1% | ~91% | ~89% |

| HumanEval | 76,8% | ~78% | ~77% |

| SWE-bench Verified | 80,6% | ~82% | ~80% |

| Codeforces Rating | 3.206 | ~3.100 | ~2.900 |

| MATH | 64,5% | ~66% | ~63% |

V4-Pro è in vantaggio nella programmazione competitiva e eguaglia o supera GPT-5.4 in diversi compiti di codifica. La modalità di ragionamento esteso (V4-Pro-Max) ha ottenuto il 93,5% su LiveCodeBench e l’89,8% su IMOAnswerBench.

Il divario tra i modelli open-source e quelli chiusi non è mai stato così piccolo. In alcuni compiti, è scomparso del tutto.

Come usare DeepSeek V4 sul Playground

Ci vogliono circa cinque secondi:

1. Apri il Playground.

Vai su playground.felo.ai nel tuo browser. Non è necessario effettuare l'accesso.

2. Seleziona DeepSeek V4 nel selettore di modelli.

Vedrai un menu a discesa con tutti i modelli disponibili. Scegli V4-Pro per compiti complessi o V4-Flash per risposte rapide.

3. Inizia a chattare.

Scrivi la tua domanda in modo naturale. Il modello risponde in tempo reale, proprio come in qualsiasi altra interfaccia di chat che hai utilizzato prima.

Questo è tutto il setup. Nessuna configurazione della chiave API, nessun limite di token, nessuna pagina di fatturazione.

Alcune cose che vale la pena provare

Se non sei sicuro da dove iniziare, ecco alcuni prompt che mostrano cosa può fare V4:

- Incolla un lungo file di codice e chiedi a V4-Pro di trovare bug o suggerire refactoring

- Proponi un problema di matematica — a livello di competizione se vuoi metterlo alla prova

- Chiedigli di spiegare un concetto tecnico in un modo specifico ("spiega i transformer come se fossi un ingegnere di database")

- Inserisci l’abstract di un articolo di ricerca e chiedi un’analisi critica

- Prova lo stesso prompt su V4-Pro e GPT-5.4 fianco a fianco — il Playground lo rende facile

Quando scegliere V4-Pro rispetto a V4-Flash

Entrambi i modelli sono disponibili nel Playground, e la scelta tra i due è semplice.

V4-Pro è il modello da usare quando la domanda è difficile. Sintesi di ricerche, debug di codice complesso, dimostrazioni matematiche, analisi di documenti lunghi — tutto ciò che trae beneficio da un ragionamento profondo. È più lento, ma ragiona più a fondo.

V4-Flash è per tutto il resto. Ricerche rapide di fatti, stesura di testi, brainstorming, traduzioni, riassunti. Risponde più velocemente e gestisce i compiti di routine altrettanto bene del modello più grande. Se affronti molte domande in una sessione, V4-Flash mantiene il ritmo.

Una buona regola generale: inizia con V4-Flash. Se la risposta sembra superficiale o il compito è chiaramente complesso, passa a V4-Pro. Il Playground ti permette di cambiare modello durante la conversazione, quindi non c’è alcuna penalità per sperimentare.

Perché il Playground è importante per provare nuovi modelli

Ogni volta che viene rilasciato un nuovo modello, si presenta lo stesso problema: come provarlo concretamente?

L’API ufficiale richiede la registrazione, l’aggiunta di una carta di credito, la scrittura di codice per effettuare richieste e la gestione dei costi dei token. Va bene se stai integrando il modello in un prodotto, ma è eccessivo se vuoi solo fargli qualche domanda e vedere come ragiona.

Felo LLM Playground elimina completamente questo processo. Quando viene lanciato un nuovo modello, apri una scheda del browser e lo usi subito. Nessuna configurazione, nessun costo, nessun impegno.

Questo conta più di quanto sembri. La differenza tra "Dovrei provare quel nuovo modello" e il fatto di provarlo davvero è di solito una ventina di minuti di configurazione dell’account e dell’API. Il Playground riduce tutto ciò a zero.

Rende anche il confronto tra modelli effettivamente pratico. Vuoi sapere se DeepSeek V4 gestisce meglio il tuo caso d’uso rispetto a Claude o GPT? Poni la stessa domanda a ciascun modello in schede adiacenti. Imparerai di più in cinque minuti di test pratici che leggendo tabelle di benchmark.

Cosa rende DeepSeek V4 degno di essere provato

Oltre ai numeri dei benchmark, V4 ha alcune caratteristiche davvero interessanti da provare di persona:

Tre modalità di ragionamento. V4 offre Non-Think (risposte rapide e dirette), Think High (analisi passo per passo) e Think Max (il massimo sforzo di ragionamento). La differenza si percepisce — Think Max su un problema di matematica complesso produce un lavoro sensibilmente più accurato rispetto alla modalità predefinita. Nel Playground, questo significa che puoi regolare quanta potenza di calcolo il modello applica alla tua domanda. Un rapido controllo fattuale non richiede Think Max. Una dimostrazione complessa sì.

Ottime prestazioni multilingue. V4 è stato addestrato con grande enfasi sui dati multilingue. Se lavori tra più lingue — inglese e cinese, giapponese e coreano, o qualsiasi combinazione — V4 gestisce bene il code-switching e le domande tra lingue diverse. Fai una domanda in inglese su una fonte in cinese, e non perderà un colpo.

Capacità di programmazione. Con una valutazione Codeforces di 3.206 e un punteggio dell’80,6% su SWE-bench, V4-Pro è uno dei modelli di programmazione più potenti disponibili oggi. Chiedigli di scrivere una funzione, revisionare una pull request o spiegarti perché la tua regex non corrisponde — è costantemente affidabile. Il Playground è un modo rapido per testarlo: incolla un frammento di codice, chiedi una revisione e confronta il feedback di V4 con quello di Claude o GPT.

Il contesto da un milione di token. La maggior parte dei modelli si ferma a 128K o 200K token. V4 arriva fino a un milione. Sono circa 750.000 parole — circa 10 romanzi completi o l’intera documentazione interna di un’azienda di medie dimensioni. Puoi incollare l’intero codice di un progetto e porre domande senza dover prima suddividere o riassumere. I modelli precedenti ti obbligavano a spezzare il lavoro in parti. V4 lo gestisce tutto insieme.

Casi d’uso pratici sul Playground

Ecco alcuni modi in cui le persone stanno già utilizzando DeepSeek V4 sul Playground:

Sviluppatori incollano il codice e chiedono a V4-Pro di esaminarlo, suggerire ottimizzazioni o spiegare schemi non familiari. Il contesto da un milione di token significa che puoi inserire un intero modulo — non solo una singola funzione — e ottenere un feedback che tenga conto dell’intero quadro. Alcuni sviluppatori usano V4-Flash per rapide domande di sintassi e V4-Pro per discussioni a livello di architettura.

Studenti usano V4-Pro-Max per esercizi di matematica e scienze. La modalità di ragionamento Think Max guida le dimostrazioni passo dopo passo, il che la rende utile non solo per ottenere risposte ma anche per comprendere l’approccio. È anche molto efficace nello spiegare concetti a diversi livelli — chiedigli di spiegare la discesa del gradiente a uno studente del primo anno rispetto a un dottorando e otterrai risposte significativamente diverse.

Ricercatori forniscono a V4 riassunti di articoli o sezioni complete e chiedono analisi critiche, lacune metodologiche o collegamenti a lavori correlati. Anche l’addestramento multilingue è utile qui — V4 può lavorare con fonti in cinese, giapponese o coreano e discuterne in inglese senza perdere sfumature.

Scrittori e marketer usano V4-Flash per il brainstorming, la stesura e la revisione. È abbastanza veloce per un lavoro iterativo — scrivi una bozza, ottieni un feedback, rivedi, ripeti — senza la latenza che rende frustranti i modelli più grandi per sessioni di botta e risposta.

Confronto tra DeepSeek V4 e altri modelli sul Playground

Il Playground ti dà accesso a modelli di diversi fornitori. Ecco come si inserisce V4:

Nei compiti di programmazione, V4-Pro è tra i migliori disponibili. Supera Claude Opus 4.6 su Codeforces e SWE-bench, e si alterna con GPT-5.4 a seconda del compito specifico.

Per quanto riguarda la scrittura e il rispetto delle istruzioni, Claude ha ancora un vantaggio. Se hai bisogno di una prosa sfumata o di un’attenta aderenza a istruzioni di formattazione complesse, i modelli Claude tendono a essere più affidabili.

Per quanto riguarda la conoscenza generale e il ragionamento, V4-Pro, GPT-5.4 e Gemini 3.1 Pro si differenziano solo di pochi punti percentuali tra loro. Nella pratica, la differenza è difficile da notare nella maggior parte delle domande.

Per quanto riguarda la velocità nelle attività di routine, V4-Flash è difficile da battere. È reattivo e sufficientemente capace per la grande maggioranza delle domande quotidiane.

Il vero vantaggio del Playground è che non devi fidarti della parola di nessuno. Puoi fare il tuo confronto. Tutti i modelli sono lì, a portata di mano.

Domande frequenti

DeepSeek V4 è davvero gratuito su Felo Playground?

Sì. Sia V4-Pro che V4-Flash sono disponibili gratuitamente. Non è necessario creare un account né inserire dati di pagamento.

Devo installare qualcosa?

No. Felo LLM Playground funziona interamente nel browser all’indirizzo playground.felo.ai. Funziona su desktop e dispositivi mobili.

Posso usare DeepSeek V4 in lingue diverse dall'inglese?

Sì. V4 funziona bene in inglese, cinese, giapponese, coreano e molte altre lingue. È stato addestrato con una forte attenzione al multilinguismo.

Qual è la differenza tra Felo Playground e Felo Search?

Felo Search combina modelli di intelligenza artificiale con la ricerca web in tempo reale per fornire risposte basate su informazioni aggiornate, con citazioni. Il Playground è un'interfaccia di chat diretta — nessuna ricerca web, solo tu e il modello. Usa Search quando hai bisogno di fatti aggiornati; usa il Playground quando vuoi ragionare, programmare, scrivere o esplorare idee.

C'è un limite di utilizzo?

Il Playground è gratuito. Possono essere applicati limiti di velocità specifici durante i periodi di traffico intenso, ma non ci sono budget di token o limiti giornalieri per l'uso normale.

Prova subito DeepSeek V4

DeepSeek V4 è disponibile su Felo LLM Playground. Apri una scheda, scegli il modello e scopri cosa può fare un modello open-source da un trilione di parametri per il tuo lavoro.