Experimente o DeepSeek V4 gratuitamente no Felo LLM Playground

O Felo LLM Playground adiciona o DeepSeek V4-Pro e o V4-Flash no dia do lançamento. Converse gratuitamente com o modelo open-source de trilhões de parâmetros — sem necessidade de chave de API.

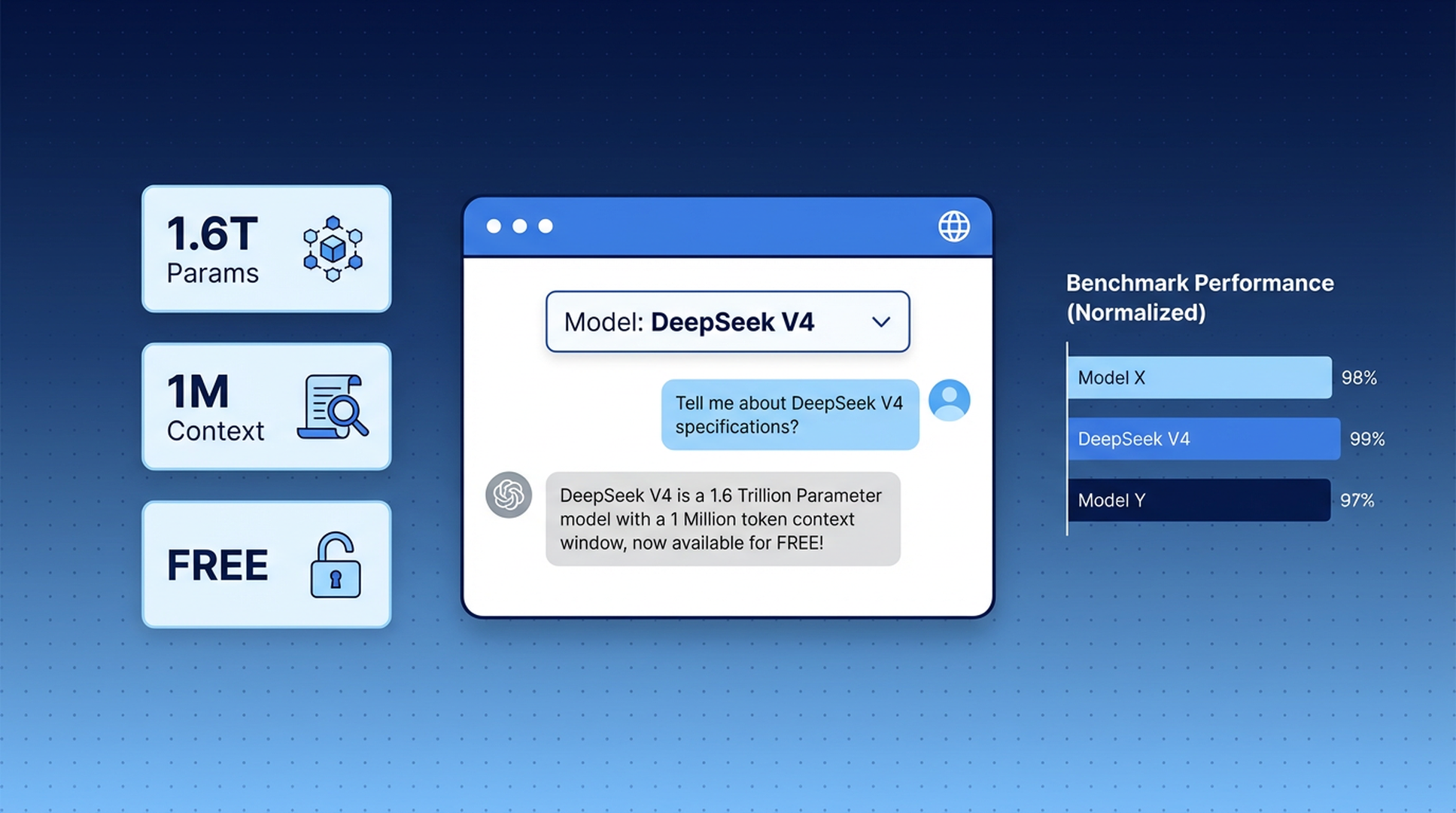

O DeepSeek V4 foi lançado esta semana — um modelo de código aberto com um trilhão de parâmetros que rivaliza com o GPT-5.4 e o Claude Opus 4.6 na maioria dos benchmarks. É o modelo de pesos abertos mais poderoso lançado até agora.

Você pode conversar com ele agora mesmo no Felo LLM Playground, gratuitamente. Sem chave de API, sem créditos, sem necessidade de conta. Basta escolher o modelo e começar a conversar.

O que é o Felo LLM Playground?

O Felo LLM Playground é uma interface de chat gratuita baseada em navegador onde você pode conversar lado a lado com os principais modelos de IA do mundo. Pense nele como uma cozinha de testes para LLMs — você traz as perguntas e escolhe qual modelo vai respondê-las.

Atualmente, o Playground oferece suporte a modelos da OpenAI, Anthropic, Google e agora DeepSeek. Você pode alternar entre os modelos no meio da conversa, comparar respostas e descobrir qual funciona melhor para sua tarefa específica — tudo isso sem precisar criar contas de API separadas ou gerenciar faturamento.

Ele foi criado para qualquer pessoa que queira experimentar os modelos mais recentes sem atritos. Desenvolvedores avaliando modelos para um projeto. Pesquisadores comparando qualidade de raciocínio. Estudantes que precisam de um assistente de IA capaz, mas não querem pagar US$20 por mês para cada provedor. Ou qualquer um que esteja apenas curioso para saber como é usar um modelo com um trilhão de parâmetros.

DeepSeek V4: o que você está obtendo acesso

O DeepSeek V4 é disponibilizado em duas variantes, e ambas estão disponíveis no Playground:

DeepSeek V4-Pro é o modelo em tamanho completo. 1,6 trilhão de parâmetros totais, 49 bilhões ativos por consulta, treinado em 32 trilhões de tokens. Ele lida com raciocínio complexo, programação, matemática e análise de documentos longos em um nível que compete diretamente com os melhores modelos fechados.

DeepSeek V4-Flash é a versão rápida. 284 bilhões de parâmetros totais, 13 bilhões ativos. Ele oferece respostas rápidas e competentes para perguntas do dia a dia, sem a latência do modelo maior.

Ambos compartilham uma janela de contexto de um milhão de tokens — suficiente para processar uma base de código inteira, um documento do tamanho de um livro ou meses de anotações de reuniões em uma única conversa.

Como ele se compara

Aqui está onde o V4-Pro se posiciona em relação aos pesos-pesados atuais:

| Benchmark | DeepSeek V4-Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|

| MMLU | 90,1% | ~91% | ~89% |

| HumanEval | 76,8% | ~78% | ~77% |

| SWE-bench Verified | 80,6% | ~82% | ~80% |

| Classificação Codeforces | 3.206 | ~3.100 | ~2.900 |

| MATH | 64,5% | ~66% | ~63% |

O V4-Pro lidera em programação competitiva e iguala ou supera o GPT-5.4 em várias tarefas de codificação. O modo de raciocínio estendido (V4-Pro-Max) alcançou 93,5% no LiveCodeBench e 89,8% no IMOAnswerBench.

A diferença entre modelos de código aberto e fechado nunca foi tão pequena. Em algumas tarefas, ela desapareceu completamente.

Como usar o DeepSeek V4 no Playground

Leva cerca de cinco segundos:

1. Abra o Playground.

Acesse playground.felo.ai no seu navegador. Não é necessário fazer login.

2. Selecione o DeepSeek V4 no seletor de modelos.

Você verá um menu suspenso com todos os modelos disponíveis. Escolha V4-Pro para tarefas complexas ou V4-Flash para respostas rápidas.

3. Comece a conversar.

Digite sua pergunta naturalmente. O modelo responde em tempo real, como em qualquer interface de chat que você já tenha usado.

Essa é toda a configuração. Sem configuração de chave de API, sem orçamentos de tokens, sem página de faturamento.

Algumas coisas que valem a pena tentar

Se você não tem certeza de por onde começar, aqui estão alguns prompts que mostram o que o V4 pode fazer:

- Cole um arquivo de código longo e peça ao V4-Pro para encontrar erros ou sugerir refatorações

- Apresente um problema de matemática — em nível de competição se quiser desafiar o sistema

- Peça para explicar um conceito técnico de uma maneira específica ("explique transformadores como se eu fosse um engenheiro de banco de dados")

- Cole o resumo de um artigo científico e solicite uma análise crítica

- Tente o mesmo prompt no V4-Pro e no GPT-5.4 lado a lado — o Playground facilita isso

Quando escolher V4-Pro vs. V4-Flash

Ambos os modelos estão disponíveis no Playground, e escolher entre eles é simples.

V4-Pro é o modelo a ser usado quando a pergunta é difícil. Síntese de pesquisas, depuração de código complexo, provas matemáticas, análise de documentos longos — qualquer tarefa que se beneficie de um raciocínio profundo. É mais lento, mas pensa de forma mais aprofundada.

V4-Flash é para todo o resto. Consultas rápidas de fatos, redação de textos, brainstorming, traduções, resumos. Ele responde mais rápido e lida com tarefas rotineiras tão bem quanto o modelo maior. Se você for fazer muitas perguntas em uma sessão, o V4-Flash mantém o ritmo.

Uma boa regra prática: comece com o V4-Flash. Se a resposta parecer superficial ou a tarefa for claramente complexa, troque para o V4-Pro. O Playground permite mudar de modelo no meio da conversa, então não há penalidade por experimentar.

Por que o Playground é importante para testar novos modelos

Toda vez que um novo modelo é lançado, surge o mesmo problema: como realmente testá-lo?

A API oficial exige cadastro, adicionar um cartão de crédito, escrever código para fazer solicitações e gerenciar custos de tokens. Isso é ótimo se você estiver integrando o modelo a um produto. Mas é exagerado se você só quiser fazer algumas perguntas e ver como ele pensa.

O Felo LLM Playground elimina todo esse processo. Um novo modelo é lançado, você abre uma aba no navegador e já está usando. Sem configuração, sem custo, sem compromisso.

Isso é mais importante do que parece. A diferença entre “Devo testar esse novo modelo” e realmente testá-lo costuma ser 20 minutos de configuração de conta e API. O Playground reduz isso a zero.

Ele também torna a comparação de modelos prática. Quer saber se o DeepSeek V4 lida melhor com o seu caso de uso do que o Claude ou o GPT? Faça a mesma pergunta a cada modelo em abas adjacentes. Você aprenderá mais em cinco minutos de testes práticos do que lendo tabelas de benchmark.

O que torna o DeepSeek V4 digno de ser testado

Além dos números de benchmark, o V4 tem algumas características que são genuinamente interessantes de experimentar em primeira mão:

Três modos de raciocínio. O V4 oferece Non-Think (respostas rápidas e diretas), Think High (análise passo a passo) e Think Max (máximo esforço de raciocínio). É possível sentir a diferença — o Think Max em um problema matemático difícil produz um trabalho visivelmente mais completo do que o modo padrão. No Playground, isso significa que você pode ajustar o quanto de poder computacional o modelo dedica à sua pergunta. Uma verificação rápida de fatos não precisa do Think Max. Uma demonstração complicada, sim.

Forte desempenho multilíngue. O V4 foi treinado com forte ênfase em dados multilíngues. Se você trabalha entre idiomas — inglês e chinês, japonês e coreano ou qualquer combinação — o V4 lida bem com alternância de código e perguntas interlinguísticas. Faça uma pergunta em inglês sobre uma fonte em chinês e ele responderá sem hesitar.

Capacidade de programação. Com uma pontuação de 3.206 no Codeforces e 80,6% no SWE-bench, o V4-Pro é um dos modelos de programação mais fortes disponíveis hoje. Peça para escrever uma função, revisar um pull request ou explicar por que sua regex não está correspondendo — ele é consistentemente bom. O Playground é uma forma rápida de testar isso: cole um trecho de código, peça uma revisão e compare o feedback do V4 com o do Claude ou GPT.

O contexto de um milhão de tokens. A maioria dos modelos é limitada a 128K ou 200K tokens. O V4 lida com um milhão. Isso equivale a aproximadamente 750.000 palavras — cerca de 10 romances completos, ou toda a documentação interna de uma empresa de médio porte. Você pode colar todo o código de um projeto e fazer perguntas sobre ele sem precisar fragmentar ou resumir primeiro. Modelos anteriores obrigavam você a dividir esse trabalho em partes. O V4 aceita tudo de uma vez.

Casos de uso práticos no Playground

Aqui estão algumas maneiras pelas quais as pessoas já estão usando o DeepSeek V4 no Playground:

Desenvolvedores colam código e pedem ao V4-Pro para revisá-lo, sugerir otimizações ou explicar padrões desconhecidos. O contexto de um milhão de tokens significa que você pode inserir um módulo inteiro — não apenas uma única função — e receber feedback que considera o quadro completo. Alguns desenvolvedores usam o V4-Flash para dúvidas rápidas de sintaxe e o V4-Pro para discussões em nível de arquitetura.

Estudantes usam o V4-Pro-Max para conjuntos de problemas de matemática e ciências. O modo de raciocínio Think Max percorre provas passo a passo, o que o torna útil não apenas para obter respostas, mas para entender a abordagem. Ele também é forte em explicar conceitos em diferentes níveis — peça para explicar o gradiente descendente a um estudante de primeiro ano versus um candidato a doutorado, e você obterá respostas significativamente diferentes.

Pesquisadores fornecem ao V4 resumos ou seções completas de artigos e pedem análises críticas, lacunas metodológicas ou conexões com trabalhos relacionados. O treinamento multilíngue é útil aqui também — o V4 pode trabalhar com fontes em chinês, japonês ou coreano e discuti-las em inglês sem perder nuances.

Redatores e profissionais de marketing usam o V4-Flash para brainstorming, redação e edição. Ele é rápido o suficiente para um trabalho iterativo — escreva um rascunho, receba feedback, revise e repita — sem a latência que torna os modelos maiores frustrantes para sessões de ida e volta.

Comparando o DeepSeek V4 com outros modelos no Playground

O Playground oferece acesso a modelos de diversos provedores. Veja como o V4 se encaixa:

Em tarefas de codificação, o V4-Pro está entre os melhores disponíveis. Ele supera o Claude Opus 4.6 no Codeforces e no SWE-bench, e alterna a liderança com o GPT-5.4 dependendo da tarefa específica.

Em redação e obediência a instruções, o Claude ainda tem uma vantagem. Se você precisa de uma redação mais sutil ou de uma adesão cuidadosa a instruções de formatação complexas, os modelos Claude tendem a ser mais confiáveis.

Em conhecimento geral e raciocínio, o V4-Pro, GPT-5.4 e Gemini 3.1 Pro estão todos dentro de alguns pontos percentuais um do outro. A diferença prática é difícil de perceber na maioria das perguntas.

Em velocidade para tarefas rotineiras, o V4-Flash é difícil de superar. É responsivo e suficientemente capaz para a grande maioria das perguntas do dia a dia.

A verdadeira vantagem do Playground é que você não precisa acreditar na palavra de ninguém. Faça a sua própria comparação. Os modelos estão todos lá.

Perguntas frequentes

O DeepSeek V4 é realmente gratuito no Felo Playground?

Sim. Tanto o V4-Pro quanto o V4-Flash estão disponíveis sem custo. Você não precisa criar uma conta ou inserir informações de pagamento.

Preciso instalar alguma coisa?

Não. O Felo LLM Playground roda completamente no navegador em playground.felo.ai. Funciona em desktop e dispositivos móveis.

Posso usar o DeepSeek V4 em outros idiomas além do inglês?

Sim. O V4 tem um bom desempenho em inglês, chinês, japonês, coreano e muitos outros idiomas. Ele foi treinado com um forte foco multilíngue.

Qual é a diferença entre o Felo Playground e o Felo Search?

O Felo Search combina modelos de IA com pesquisa em tempo real na web para oferecer respostas baseadas em informações atuais, com citações. O Playground é uma interface de chat direto — sem pesquisa na web, apenas você e o modelo. Use o Search quando precisar de fatos atualizados; use o Playground quando quiser raciocinar, programar, escrever ou explorar ideias.

Há algum limite de uso?

O Playground é gratuito para usar. Limites específicos de taxa podem ser aplicados durante períodos de alto tráfego, mas não há orçamentos de tokens ou limites diários para uso normal.

Experimente o DeepSeek V4 agora

O DeepSeek V4 está disponível no Felo LLM Playground. Abra uma aba, escolha o modelo e veja o que um modelo de código aberto com trilhões de parâmetros pode fazer pelo seu trabalho.