Come utilizzare il modello LLaMA 3.1 di Meta gratuitamente su Felo AI Chat?

Siamo entusiasti di annunciare il lancio dell'ultimo modello Llama 3.1 di Meta, ora disponibile gratuitamente su Felo Chat! Questa nuova versione, che è stata presentata il 23 luglio 2024, porta miglioramenti significativi rispetto al suo predecessore, tra cui capacità avanzate multilingue, formati di prompt ottimizzati e nuovi strumenti potenti. Unisciti a noi mentre esploriamo come sfruttare queste funzionalità per migliorare la tua esperienza di chat e impegnarti in conversazioni dinamiche e significative. Non perdere l'occasione di provare Llama 3.1 gratuitamente!

**Introduzione**

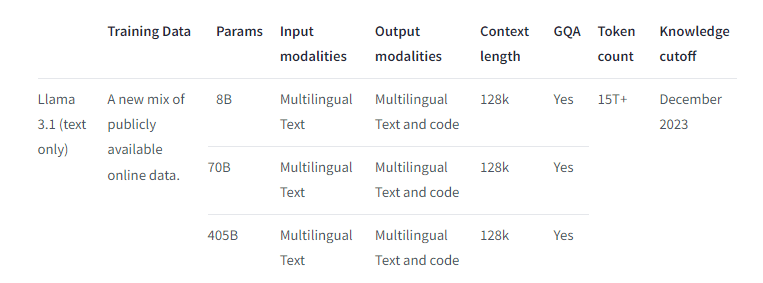

Il 23 luglio 2024, MeTA ha rilasciato la versione più recente di Llama: Llama 3.1. Questo entusiasmante aggiornamento include modelli solo testo ottimizzati per istruzioni (8B, 70B, 405B), progettati specificamente per applicazioni di dialogo multilingue. Llama 3.1 supera molti modelli di chat open-source e chiusi esistenti su benchmark industriali comuni, offrendo prestazioni e capacità migliorate.

Il modello Llama 3.1 può ora essere provato gratuitamente su Felo AI Chat. Clicca qui per provare LLAMA3.1.

Aggiornamenti Chiave in Llama 3.1

### Introduzione di un Nuovo Carattere: "ipython"

Llama 3.1 introduce un nuovo carattere chiamato “ipython,” progettato per contrassegnare gli output delle chiamate agli strumenti. Questo progresso consente al modello di gestire interazioni multi-passaggio e utilizzo degli strumenti in modo più efficace.

### Formato di Prompt Ottimizzato

Sebbene il formato di prompt di Llama 3 rimanga applicabile in Llama 3.1, si incoraggiano gli sviluppatori ad aggiornare al nuovo formato di prompt per risultati migliori. Ciò include aggiustamenti nella struttura e nel contenuto dei prompt per sfruttare meglio le capacità del modello.

### Capacità di Chiamata agli Strumenti Migliorate

Llama 3.1 supporta una varietà di strumenti integrati come Brave Web Search, Wolfram Alpha e Code Interpreter. Può anche generare chiamate corrispondenti a funzioni Python, rendendo il modello più flessibile nella gestione di query complesse.

### Chiamata agli Strumenti Personalizzati

Gli sviluppatori possono definire formati di chiamata agli strumenti personalizzati e fornire definizioni degli strumenti nei prompt di sistema. Questa funzione consente al modello di generare chiamate appropriate in base a queste definizioni.

### Supporto per il Ragionamento Multi-Passaggio

Il modello può utilizzare marcatori speciali (come <|eom_id|>) durante i processi di ragionamento multi-passaggio per indicare quando è necessaria ulteriore generazione, migliorando le sue prestazioni durante interazioni complesse.

## Come Provare Llama 3.1 Gratuitamente

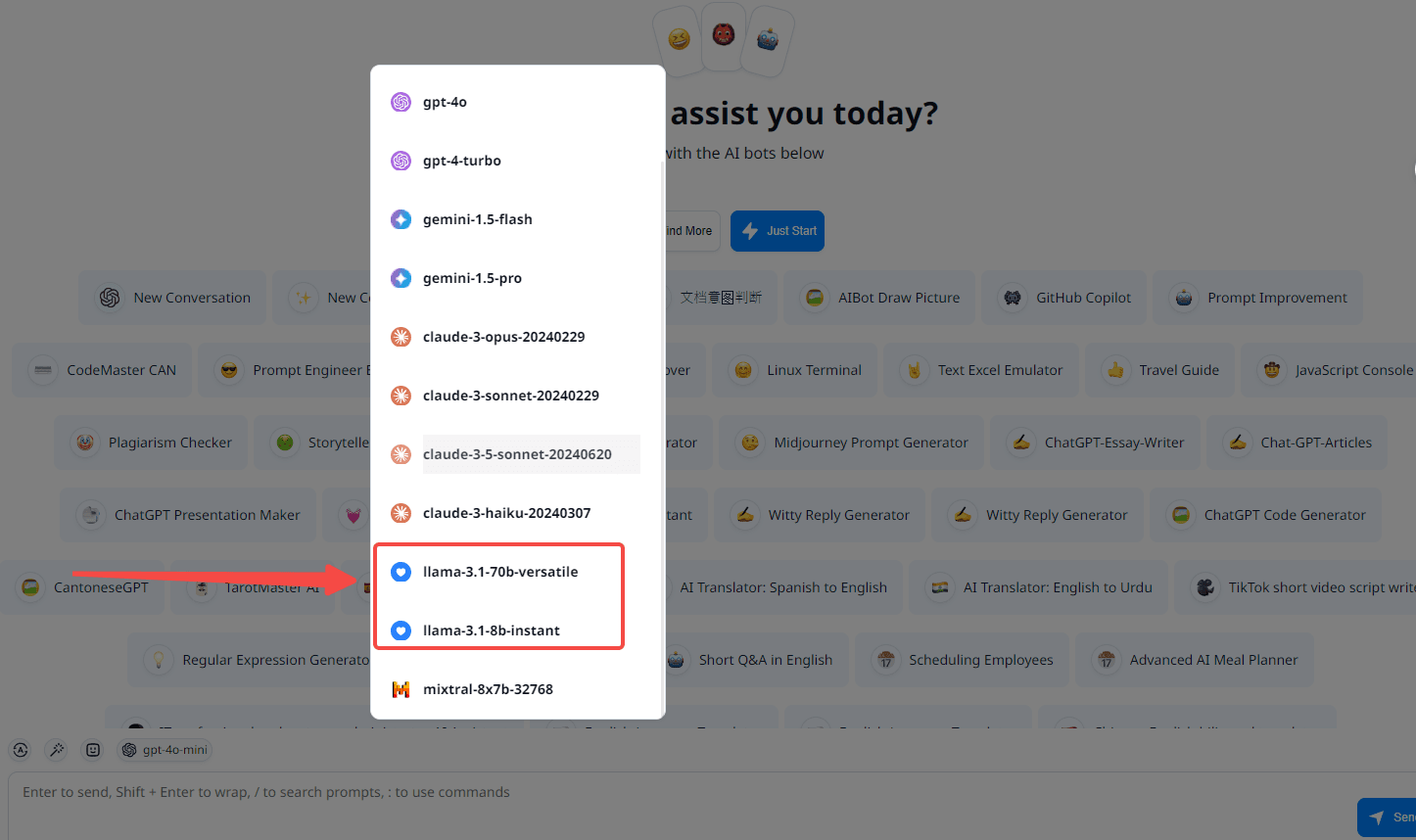

Per provare il modello Llama 3.1 senza costi, visita semplicemente chat.felo.ai e seleziona il modello Llama 3.1, come mostrato nello screenshot qui sotto. Gli utenti possono godere di accesso gratuito al modello Llama 3.1 ogni giorno. Il modello opera a una velocità impressionante e viene fornito con tre strumenti integrati che eccellono nel fornire informazioni tempestive, ragionamento, calcoli matematici e output di codice.

## Alcuni Parametri di Llama 3.1

Fai riferimento allo screenshot qui sotto per dettagli sulla lunghezza del contesto e altri parametri.

Allora, cosa stai aspettando? Immergiti negli aggiornamenti straordinari di Llama 3.1 su Felo Chat e provalo tu stesso oggi!